2026年3月,AI编程工具赛道发生了一场堪称"教科书级别"的公关危机。

估值高达500亿美元的明星公司Cursor,在发布其最新编程模型Composer 2时,宣称这是"自研模型"。然而,有开发者在调试API时,从日志中意外发现了一个刺眼的标识:"kimi-k2p5-rl"。

这个标识直接指向了中国公司月之暗面(Moonshot AI)的Kimi K2.5模型。

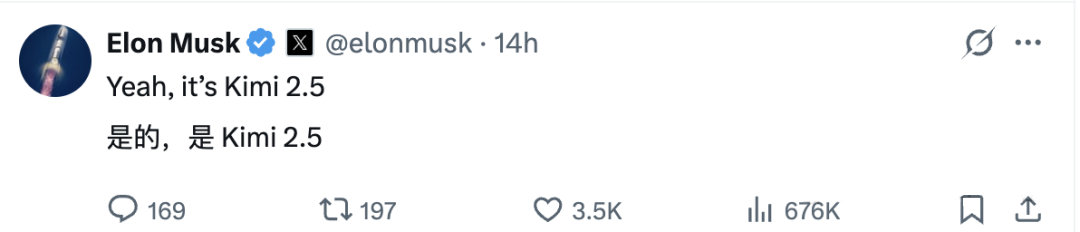

消息迅速在开发者社区发酵,甚至连埃隆·马斯克都在社交媒体上确认了这一发现。面对质疑,Cursor联合创始人Aman Sanger和核心成员Lee Robinson不得不站出来回应:是的,我们用了Kimi K2.5作为基座模型,因为"它是目前最强的"。

更戏剧性的是,月之暗面预训练负责人杜羽伦通过技术测试发现,Composer 2的分词器(tokenizer)与Kimi完全一致,从技术层面彻底实锤了"套壳"事实。

但真正让这件事成为行业标志性事件的,不是技术上的"套壳",而是背后的商业逻辑和伦理困境。

根据Kimi K2.5修改后的MIT许可证,若衍生产品的月活跃用户超过1亿或月收入超过2000万美元,必须在产品中显著标明"Kimi K2.5"。而Cursor的年报显示,其年经常性收入(ARR)约20亿美元,估值500亿美元,远超触发署名义务的门槛数百倍。

Cursor方面的解释是:"这是一个疏忽,忘记署名了。"

这个解释,在AI行业从业者看来,既真实得可怕,又荒谬得可笑。

如果我们把时间倒回2025年7月,在K2发布后不久,月之暗面创始人杨植麟接受张小珺商业访谈录采访时,就已经为今天的事件埋下了伏笔。

在那次访谈中,杨植麟清晰地划分了"一方产品"和"三方产品"两种完全不同的逻辑:

三方产品(如Manus)的逻辑:逆向工程模型训练过程——猜什么工具、什么System Prompt、什么Context Engineering效果好。

一方产品(如Claude Code)的逻辑:正向设计——先把工具和环境设计好,直接在黑盒里训练模型,模型天然适配你的环境。

杨植麟当时就明确指出:"第二种思路上限也许更高——你可以更好整合工具和模型。"

站在2026年3月回看,Cursor Composer 2恰恰是一个典型的"三方产品"案例。

他们没有选择从零训练基座模型,而是选择了"逆向工程"——评估了大量基座模型后,选择了当时最强的Kimi K2.5,然后在其基础上进行后训练(post-training)和强化学习(RL)训练。

Cursor方面透露,他们在Kimi K2.5基础上"消耗了数倍于基座模型的算力"进行后续训练。这个说法本身就有意思——如果消耗了数倍算力,那到底算"自研"还是"套壳"?

从技术角度看,Cursor确实做了大量工作。但从商业伦理角度看,问题就复杂得多。

杨植麟在访谈中提到的另一个关键观点,或许能解释为什么Cursor会"忘记署名":

"一方产品和三方产品是两种根本不同的逻辑。"

对于Cursor这样的应用层公司来说,他们的核心叙事是"我们做出了最好的AI编程工具",而不是"我们基于Kimi K2.5做了二次开发"。在资本市场的叙事逻辑里,前者估值可以是500亿美元,后者可能就要打对折。

这不是简单的"忘记",而是商业利益驱动下的选择性遗忘。

要理解为什么Cursor会选择Kimi K2.5,我们必须回到杨植麟在访谈中反复强调的一个概念:Token Efficiency(令牌效率)。

在2025年,AI行业已经明确进入了"数据墙"时代。高质量数据接近常数,怎么办?杨植麟给出的答案是:提升token efficiency——让每份数据产生更大价值。

Kimi K2.5的核心突破,用杨植麟的话说就是:"喂一样多的数据,'脑子'长得更多。"

具体技术方案包括:

1. Muon优化器

Adam优化器用了10年,但token效率不够好

Muon把矩阵参数整体考虑依赖关系

实验结果:学1份数据 ≈ 用Adam学2份

30T高质量token → 等价60T的效果

2. 数据改写策略

高质量数据反复学会过拟合

通过改写让同一份数据产生泛化能力

关键:改写是否引入了新的熵

这些技术突破,让Kimi K2.5在同等数据量下,性能显著超越竞争对手。这也是为什么Cursor会承认:"Kimi K2.5是其中最强的。"

但这里有一个更深层的问题:当基座模型的性能差距缩小到一定程度,应用层公司的"护城河"到底在哪里?

Cursor的答案是:在Kimi K2.5基础上进行大量的后训练和RL训练,针对编程场景做深度优化。他们声称消耗了"数倍于基座模型的算力"。

这个策略本身没有问题。问题在于,当你99%的用户感知到的"智能"都来自于基座模型时,你是否还应该宣称这是"自研模型"?

杨植麟在访谈中提到了一个关键判断:"今天Agent还不像对话有这么好的泛化性——接下来要山上几百个台阶,有可能是这个。"

换句话说,基座模型的泛化能力,决定了上层应用的上限。Cursor的Composer 2再优秀,也跳不出Kimi K2.5的能力边界。

这就是为什么"忘记署名"在技术伦理上如此严重——它模糊了能力来源的真实边界。

让我们把视角拉得更宏观一些。

Cursor事件之所以引发如此大的关注,不仅仅是因为一家500亿美元估值公司的"疏忽",更是因为它暴露了整个AI行业在Agent发展上的根本困境:泛化性(Generalization)。

杨植麟在访谈中明确指出:"Agent最大的挑战:泛化性。"

他列举了当前Agent训练的核心痛点:

训SWE-bench用分布数据,只提升SWE-bench分数

指标提升 ≠ 模型泛化变好

过拟合到特定工具、环境、任务是普遍问题

评估方式片面,可用的Benchmark不多

这段话,简直就是为Cursor事件量身定做的注解。

Cursor的Composer 2在编程任务上表现优异,但这是否意味着它真正理解了编程?还是只是过拟合到了编程场景的特定模式?

杨植麟给出的解决思路是:

不过拟合单点能力,追求通用模型

用更AI native的方式训练AI——让模型参与到训练过程

可能需要在Pre-Train阶段就加入Agentic能力

这些观点,直指当前AI行业的核心矛盾:我们到底是在训练"智能",还是在训练"应试能力"?

SWE-bench分数可以很高,但换个场景就不行,这本质上就是过拟合。Cursor的Composer 2可能在编程任务上超越了GPT-4,但这是否意味着它具备了真正的"编程智能"?

更尖锐的问题是:如果连"编程"这样相对封闭、规则明确的领域都难以实现真正的泛化,那AGI的距离还有多远?

杨植麟在访谈中对AGI的理解或许能给我们一些启示:"AGI不是一级台阶,而是一个方向。"

他说:"不是某一刻突然实现的——不像登月,站上去就算到了。"

"很多领域已经AGI了——数学、编程竞赛等。"

"社会影响是更长周期的事——像蒸汽机一样需要几十年上百年消化。"

这意味着,我们不应该期待某个"AGI时刻"的到来,而应该接受AI能力渐进式提升的现实。

在这个现实下,Cursor基于Kimi K2.5开发Composer 2,本身没有问题。问题在于,你是否诚实地向用户和投资者披露了能力的真实来源?

让我们再深入一层,看看Cursor事件背后的行业大背景。

杨植麟在访谈中提出了一个尖锐的问题:"Scaling Law放缓了吗?数据飞轮为何没形成?"

他的答案是:Scaling Law遇到了数据墙——这是客观事实。

但模型变好的速度并没有减少,甚至在加速。原因包括:

RL的scaling效率比Pre-Training高很多

RL是on-policy且带负梯度的训练

提升token efficiency可以突破数据墙

但为什么没有形成数据飞轮?

杨植麟给出了三个原因:

基于算力的scaling太强大了,其他手段相比之下提升很小

大模型学习对噪声敏感,用户反馈信号噪声大

需要新的交互范式来降低信号噪声

他最后总结道:"基于FLOPs的scaling是更有效路径,但这个平衡什么时候会变化——值得观察。"

这段话,为Cursor事件提供了另一个解读角度。

在Scaling Law放缓、数据墙逼近的背景下,基座模型的性能差距正在缩小。当大家都能获得差不多的基座模型性能时,竞争就转移到了应用层。

Cursor选择了Kimi K2.5,因为它是"最强的"。但"最强"的差距可能只有几个百分点。在这种情况下,Cursor的核心竞争力就不在于基座模型,而在于:

后训练和RL训练的质量

产品体验和用户界面

生态建设和开发者社区

这就是为什么Cursor会"忘记署名"——在他们的叙事里,基座模型只是"原材料",真正的价值在于后续的"加工"。

但这种叙事在技术伦理上是站不住脚的。因为用户感知到的"智能",99%来自于基座模型,而不是后训练。

杨植麟在访谈中提到了一个关键判断:"模型越通用,系统越复杂。但不通用,泛化性又不够。"

这或许就是当前AI行业的根本困境:我们既需要通用的基座模型,又需要专用的应用模型,但这两者之间存在天然的张力。

Cursor试图通过在Kimi K2.5基础上进行深度后训练来解决这个矛盾,但在商业伦理上,他们越过了红线。

有趣的是,杨植麟在访谈中提到的管理哲学,竟然可以用来解读Cursor事件本身。

他把团队管理分为两种模式:

SFT式管理 = 告诉团队"这个事该这样做"

优点:有先验指导

缺点:团队失去主观能动性和创造力

RL式管理 = 给目标和奖励信号,让团队自主探索

优点:激发创新

缺点:容易被reward hacking——看起来结果好,实际没达到真正目标

杨植麟强调:"核心是掌握SFT和RL的平衡。以RL为主,用一部分SFT控制先验。"

把这个框架应用到Cursor事件上,我们会发现一个惊人的相似性。

资本市场给AI创业公司的"奖励信号"是什么?

高估值

快速增长的用户数

"自研技术"的叙事

在这个奖励信号下,Cursor的"最优策略"是什么?

选择最强的基座模型(Kimi K2.5)

进行大量后训练(消耗数倍算力)

宣称"自研模型"(忘记署名)

这不就是典型的"reward hacking"吗?

看起来结果好(发布了性能优异的模型,维持了500亿美元估值),实际没达到真正目标(诚实披露技术来源,建立可持续的技术生态)。

杨植麟在访谈中提到:"这个洞察在科研、模型训练、组织管理上是相通的。"

确实相通。在科研中,reward hacking表现为"刷榜"——在特定benchmark上刷高分,但实际能力没有提升。

在模型训练中,reward hacking表现为"过拟合"——在训练数据上表现完美,但泛化能力差。

在组织管理中,reward hacking表现为"指标漂亮但实际没达到目标"——就像Cursor的"忘记署名"。

这或许就是AI行业当前面临的最大挑战:我们设计的奖励信号,是否真正指向了我们想要的目标?

如果资本市场的奖励信号是"自研技术",那创业公司就会倾向于"忘记署名"。

如果学术界的奖励信号是"论文数量",那研究者就会倾向于"灌水"。

如果开源社区的奖励信号是"star数量",那开发者就会倾向于"营销"而不是"技术"。

杨植麟提出的解决方案是:"以RL为主,用一部分SFT控制先验。"

应用到行业治理上,可能就是:以市场激励为主,用法律法规和行业标准控制底线。

Kimi K2.5的修改版MIT许可证,要求月活超1亿或月收入超2000万美元的公司必须署名,这就是在尝试建立这样的"先验控制"。

Cursor的"忘记署名",本质上是对这种"先验控制"的挑战。

让我们回到最根本的问题:AI创业公司,到底应该如何定位自己与基座模型的关系?

杨植麟在访谈最后提到了一句意味深长的话:"AI是人类文明的放大器。"

他还说:"人的独特价值——体验和爱——不会被替代。创造可能很AI接手,但有好的机制,人可以享受生产的结果。"

如果把这句话扩展到AI行业内部,我们会发现:基座模型是"创造",应用层是"体验和爱"。

基座模型公司(如月之暗面、OpenAI、Anthropic)负责"创造"智能。

应用层公司(如Cursor、Manus、各种AI工具)负责把智能转化为"体验和爱"——也就是用户价值。

这两者都重要,但角色不同。

Cursor的问题不在于使用了Kimi K2.5,而在于模糊了角色边界——他们试图让自己看起来既是"创造者"又是"体验提供者"。

在资本市场的叙事里,"创造者"的估值高于"体验提供者"。所以Cursor选择了"忘记署名"。

但这种策略从长远看是不可持续的。因为:

技术真相终会暴露——就像这次被开发者从API日志中发现

损害行业信任——如果所有应用层公司都"忘记署名",那基座模型公司就没有动力开源

最终伤害的是整个生态——包括Cursor自己

杨植麟在访谈中提到:"任何中间状态都有可能成为被批评的对象——这是Kimi教我的。"

这句话或许可以用来解读Cursor事件。在"完全自研"和"诚实署名"之间的中间状态,是最容易被批评的。

Cursor如果完全自研,那没问题。

Cursor如果诚实署名"基于Kimi K2.5开发",那也没问题。

但Cursor选择了中间状态——"自研模型"但"忘记署名"——这就成为了被批评的对象。

这或许就是AI行业走向成熟的必经之路:从模糊到清晰,从混乱到规范。

Cursor事件不应该仅仅被视为一家公司的公关危机,而应该被看作AI行业建立技术伦理新范式的契机。

基于杨植麟的访谈和Cursor事件,我们可以提炼出以下几个行业共识:

当应用层公司使用开源或商业授权的基座模型时,必须明确披露。这不是"可选项",而是"必选项"。

Kimi K2.5的修改版MIT许可证设定了一个好的先例:月活超1亿或月收入超2000万美元必须署名。

这个标准应该成为行业基准。

在基座模型+后训练的模式下,什么是"自研"?

如果只做了后训练,能叫"自研模型"吗?

如果消耗了数倍于基座模型的算力,能叫"自研模型"吗?

如果用户感知到的智能99%来自基座模型,能叫"自研模型"吗?

行业需要建立更清晰的定义和标准。

杨植麟提出的"Token Efficiency"概念,应该成为评估基座模型的核心指标。

不是看训练了多少数据,而是看同样数据产生了多少智能

不是看算力消耗了多少,而是看同样算力产生了多少性能

Muon优化器让"学1份数据 ≈ 用Adam学2份",这才是真正的技术突破。

Cursor事件暴露了当前Agent发展的根本困境:泛化性不足。

SWE-bench分数再高,换个场景就不行,这本质上还是"应试教育"。

下一个技术突破点,应该是让Agent具备真正的泛化能力,而不是在特定benchmark上过拟合。

杨植麟提出的"RL式管理"和"SFT式管理"的平衡,应该扩展到整个AI行业治理。

市场激励(RL):让公司自主探索商业模式

行业规范(SFT):设定技术伦理的底线

两者缺一不可。

杨植麟在访谈中反复引用物理学家David Deutsch的《无穷的开始》中的两句话:

"问题是不可避免的"

"问题是可以被解决的"

他说:"每解决一个问题,技术就能再往上攀登几百米。也许有一天会发现,这座山没有尽头。"

The Beginning of Infinity的意思就是——它是一座无限的山。

Cursor事件,就是这座无限的山上的一个问题。

这个问题是不可避免的——当AI行业快速发展、基座模型与应用层分离、开源与商业交织时,技术伦理的边界必然会模糊。

但这个问题也是可以解决的——通过建立清晰的行业标准、技术伦理规范、法律法规框架。

关键是我们是否有勇气面对这个问题,而不是"忘记署名"。

"AI是人类文明的放大器。"

如果AI放大了人类的创造力,那它也应该放大人类的诚信。

如果AI放大了人类的效率,那它也应该放大人类的责任。

Cursor的500亿美元估值,不应该成为"忘记署名"的理由,而应该成为"带头署名"的动力。

因为在这座无限的山上,每一个攀登者都有责任为后来者留下清晰的路标,而不是模糊的足迹。

这或许就是Cursor事件给整个AI行业的最重要启示:

在追求技术无限进步的同时,我们也不能忘记技术伦理的底线。

因为只有这样,这座无限的山,才能成为人类文明的阶梯,而不是悬崖。

参考资料:

下一站